Op donderdag 12 oktober organiseerde Defenced een kennissessie over het gebruik van AI in de wereld van cybersecurity. Een bijzonder relevant onderwerp, doordat AI de laatste tijd met name door ChatGPT in een stroomversnelling is geraakt. Plots gebruikt iedereen AI en hoor je zelfs de buurman vertellen hoe makkelijk AI teksten kan schrijven van hoge kwaliteit in een handomdraai. Maar wat zijn de risico’s? En wat is de impact van deze technologie in de wereld van de cybersecurity, voor zowel de (ethisch) hacker als de security analisten?

In een volle zaal in Hotel Landgoed Het Roode Koper vertelden experts over de wereld van AI en gaven zij antwoord op de bovenstaande vragen. Tussen de sprekers door werd iedereen voorzien van een heerlijk 4 gangen diner.

In een volle zaal in Hotel Landgoed Het Roode Koper vertelden experts over de wereld van AI en gaven zij antwoord op de bovenstaande vragen. Tussen de sprekers door werd iedereen voorzien van een heerlijk 4 gangen diner.

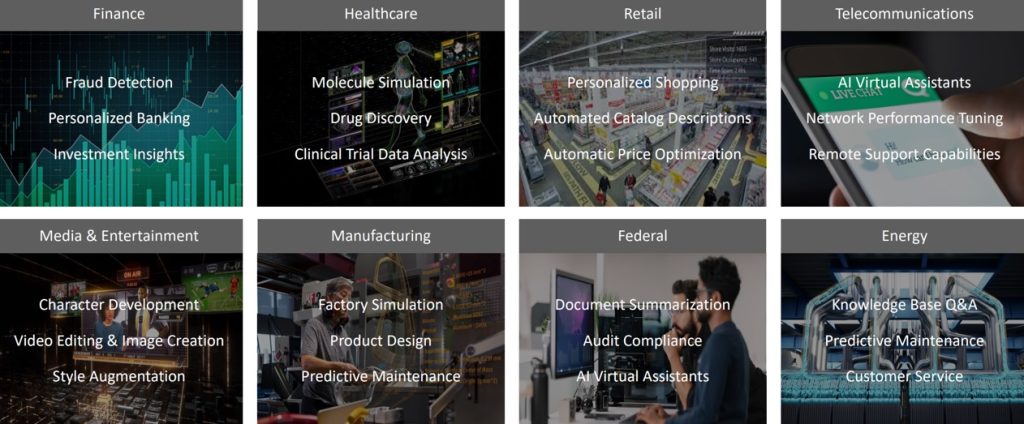

AI guru Kai Bergin van MvR Digital Workforce opende de avond met een presentatie over de verschillende toepassingen en varianten van AI. Hij sprak over de ontwikkeling vanaf 1943 tot nu, de verschillen tussen AI, Machine Learning en Generatieve AI en liet ons zien dat we allemaal al meer gebruik maken van AI dan we zelf dachten. Een echte eyeopener voor alle aanwezigen.

Generatieve AI is in staat om autonoom nieuwe inhoud te produceren. Kai gaf ons hier verschillende voorbeelden van zoals te zien in de afbeelding hieronder, en gaf ons een kijkje in de werking van ChatGPT, wat op basis van waarschijnlijkheden compleet originele nieuwe teksten kan genereren. Tot slot gaf Kai ons een kijk in de toekomst op het gebied van AI.

Een klant van Defenced deelde hierna zijn ervaring over de toegevoegde waarde van het next-gen SOC van Defenced dat gebruik maakt van AI-technologie. Een mooi succesverhaal over hoe we de digitale wereld veilig kunnen houden voor onze klanten. In dit geval gaat het om een snel groeiend en innoverend bedrijf. De grootste dreiging is hier verliezen van Intellectual Property (IP). Zeer geavanceerde hackersgroepen pogen zich tot het binnendringen van het netwerk. Dit doen ze ongetwijfeld ondersteund door AI. De brede inzetbaarheid van deze technologie moet dus ook zeker benut worden voor het voorkomen van een succesvolle aanval.

Maar hoe verandert deze technologie de wereld van cybersecurity? Onze eigen CTO Dennis van Halteren gaf een presentatie over het gebruik van Generatieve AI voor zowel de offensieve kant van de (ethisch) hackers als de defensieve kant van de security analist.

Maar hoe verandert deze technologie de wereld van cybersecurity? Onze eigen CTO Dennis van Halteren gaf een presentatie over het gebruik van Generatieve AI voor zowel de offensieve kant van de (ethisch) hackers als de defensieve kant van de security analist.

Generatieve AI brengt een hoop mogelijkheden met zich mee voor kwaadwillende om een overtuigende campagne op te zetten. Dennis gaf voorbeelden van Identity Theft, waar met behulp van Generatieve AI een taalmodel ontwikkeld kan worden aan de hand van slechts 20 minuten aan geluidsmateriaal. Zo liet hij ons een voorbeeld horen hoe Donald Trump aankondigde dat Dennis minister-president van Nederland moest worden. Gelukkig was dit gemakkelijk te herkennen als fake news, maar in een korte quiz met het publiek bleek dat het lang niet altijd zo makkelijk meer is om te bepalen of een foto écht is, of gegeneerd door een AI-model.

Hoewel het bekende ChatGPT zich onthoudt van het geven van code die voor kwaadaardige doeleinden gebruikt kan worden, liet Dennis ons zien dat er al een ruime keuze aan tools is waar deze beperking niet op zitten. Zo kan FraudGPT phishing emails generen, Evil-GPT kwaadaardige code schrijven en kan xxxGPT de gebruiker zelfs voorzien van Botnet code, Remote Access Tools (RATs) en malware. Eng om te zien. Er is niet veel kennis meer nodig om bijvoorbeeld geavanceerde malware te maken.

Gelukkig is er ook positief nieuws. Generatieve AI leent zich ook erg goed voor de analist aan de defensieve kant. Met de ervaring van Dennis in het eigen SOC van Defenced was hij de uitgelezen persoon om zijn ervaring te delen. Defenced werkt met een next-gen SOC waar AI al jaren ingezet wordt om alle data te analyseren in een Big Data model. Waar het voor een analist onmogelijk is om maanden of zelfs jaren aan data te analyseren om afwijkingen vast te stellen, kan AI dit in een kwestie van seconden. Tel hierbij op dat alle meldingen gecorreleerd kunnen worden aan elkaar om grotere incidenten makkelijker te herkennen. Dennis liet ons inzien dat het gebruik van een traditioneel SOC met een onderliggend SIEM en een traditionele use-case alerting aanpak nu eigenlijk al niet meer voldoende.

De belangrijkste takeaways van Dennis zijn presentatie zijn:

- Wees je bewust van de risico’s van AI. Het is al moeilijk om onderscheid te maken tussen wat echt is en wat niet, en deze technologie zal alleen maar verder verbeteren.

- Let op welke data je geeft aan tools zoals ChatGPT. De kans is groot dat ook jouw data gebruikt wordt voor het verbeteren en trainen van het volgende AI-model. Op deze manier kun je dus je eigen data lekken.

- Een traditioneel SOC dat werkt op basis van een set use-cases is niet meer van deze tijd. In de huidige wereld van Big Data is AI nodig om alles te analyseren, afwijkingen in normaal gedrag te detecteren en gebeurtenissen aan elkaar te correleren over langere periodes van tijd. Daarnaast geeft machine learning de mogelijkheid voor 24×7 triage en eveneens geautomatiseerde response om de impact tot een minimum te beperken.

Deze blog is geschreven door Sam Cantineau